研究所动态

喜报|我所一篇关于签到序列表示的研究被国际顶级学术期刊IEEE TKDE录用

发布时间:2024年07月25日

由我所师生合作完成的一篇论文Spatial-Temporal Cross-View Contrastive Pre-training for Check-in Sequence Representation Learning被CCF A类国际顶级期刊IEEE Transactions on Knowledge and Data Engineering(TKDE)录用,该论文由我所博士生贡乐天、林彦和万怀宇老师、郭晟楠老师、林友芳老师,硕士生郑尔文、王天一、周泽宇,以及哈尔滨工业大学(深圳)李修成老师完成。

位置服务(LBS)的快速增长产生了大量关于人类移动的数据。有效提取用户生成的签到序列的有意义表示对于促进各种下游服务至关重要。然而,用户生成的签到数据同时受到周围客观环境和用户主观意图的影响。具体来说,签到数据中表现出的时间不确定性和空间多样性使得难以捕捉用户的宏观空间-时间模式并理解用户移动活动的语义。此外,签到序列中时间和空间信息的独有特征需要一种有效的方法来进行融合。

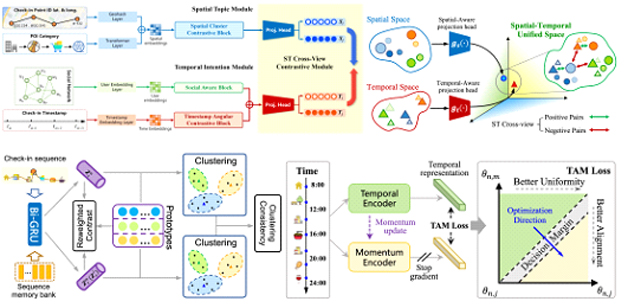

本文提出了一种新颖的空间-时间跨视图对比表示(STCCR)框架,用于签到序列表示学习。具体来说,STCCR通过“空间主题”和“时间意图”视图的自监督来解决上述挑战,促进在语义层面上有效融合空间和时间信息。此外,STCCR利用对比聚类来揭示用户在多样化移动活动中的共享空间主题,同时通过角动量对比来减轻时间不确定性和噪声的影响。我们在三个真实世界的数据集上广泛评估了STCCR,并证明了它在三个下游任务中的优越性能。